※当ページのリンクには広告が含まれています。

生成AIについて調べていると、「学習データが重要」といった説明をよく目にします。

一方で、学習データが具体的に何を指し、なぜ精度に直結するのか、どのような仕組みでモデルが“学ぶ”のかは、意外と整理しづらいテーマです。

また、ChatGPTなどの対話モデルや、Diffusion Modelのような画像生成モデルが実用化される中で、出力の品質を左右する要因としてデータ品質が注目されています。

この記事では、生成AIの学習データの定義から、自己教師あり学習やRLHF(人間フィードバックによる強化学習)などの学習手法、Transformerの役割、そしてデータ量・品質・多様性と精度(ハルシネーションを含む)の関係までを、客観的に解説します。

生成AIの学習データは「生成の土台」であり精度を左右します

生成AIの学習データとは、テキスト、画像、音声などの膨大なデータセットを指します。

生成AIはこれらのデータから、データの確率分布やパターンを学習し、新しい文章や画像などを生成する基盤を作ります。

リサーチ結果でも、生成AIは大量データから「次に来る単語や画像の出現確率」を予測することで生成を行う点が重要だと整理されています。

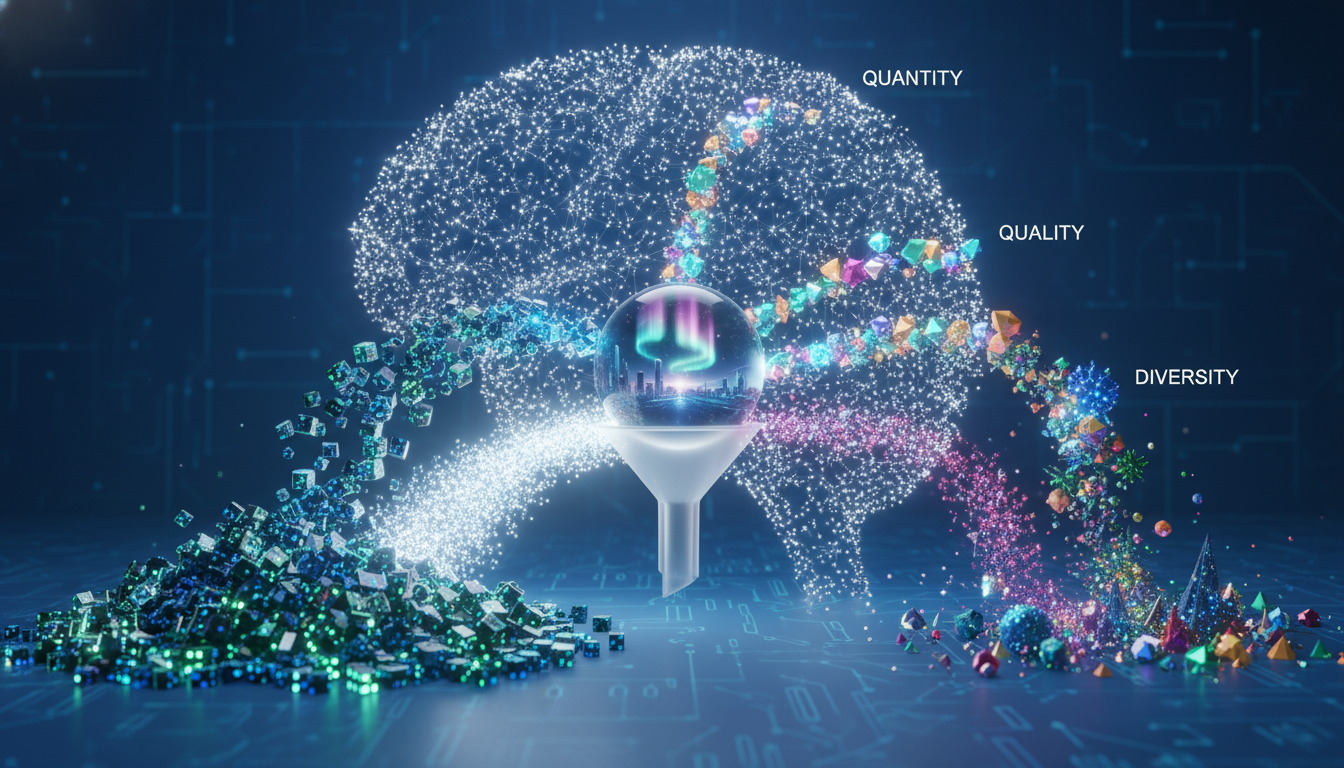

そのため、学習データの量・品質・多様性が高いほど、モデルはパターンをより正確に捉えやすくなり、出力の精度向上につながると考えられます。

一方で、低品質データや偏ったデータは誤ったパターン学習を招き、ハルシネーション(幻覚)や偏見のある出力の要因になり得ます。

学習データが生成AIの出力を形作る仕組み

生成AIは確率分布を学び、次の候補を予測します

生成AIの中核は、学習データから確率分布やパターンを学ぶことです。

テキスト生成であれば、文脈に対して「次に来る単語の確率」を推定し、その確率に基づいて文章を組み立てます。

画像生成であれば、画像の特徴量や構造のパターンを学び、プロンプトに応じた画像を生成します。

リサーチ結果でも、生成AIはディープラーニング(深層学習)を用い、ニューラルネットワークでデータの構造を捉えることで、プロンプトに応じた出力を実現するとされています。

自己教師あり学習が「大量データを学べる」前提を作ります

近年の大規模言語モデルでは、自己教師あり学習が主流の学習方法として位置づけられています。

自己教師あり学習は、データ自身からラベル(正解に相当する情報)を作り出して学習する手法です。

たとえば、文章の一部を隠して当てさせる「隠し単語予測」のようなタスクで学習し、ラベル付きデータがなくても大規模に学習を進められる点が特徴です。

この仕組みにより、テキストや画像などの膨大なデータを学習に利用しやすくなり、汎用的な知識や表現の獲得につながると考えられます。

事前学習とファインチューニングで「汎用」から「特化」へ進みます

生成AIは一般に、まず大量データで事前学習を行い、幅広い知識や言語パターンを獲得します。

その後、特定目的に合わせてファインチューニング(追加学習)を行い、業務ドメインや用途に最適化します。

リサーチ結果でも、「大量データで一般知識を獲得後、ファインチューニングで特化する」という流れが示されています。

ここで重要なのは、事前学習データがモデルの“基礎体力”を作り、ファインチューニングデータが“専門性と振る舞い”を調整する、という役割分担です。

RLHFが「人にとって望ましい応答」へ近づけます

2025年時点の最新動向として、対話型生成AIではRLHF(人間フィードバックによる強化学習)が応答品質向上の中心的手法として語られています。

RLHFは、人間の評価を報酬としてモデルを強化し、より自然で有用な応答を選びやすくする枠組みです。

同じ事前学習モデルでも、RLHFの設計や評価データの質によって、丁寧さ、安全性、指示追従性などが変わり得ると考えられます。

この点からも、学習データは単に「量が多いほど良い」というより、目的に応じたデータ設計が重要だと言えます。

Transformerが高精度な生成を支えます

生成AIの精度を語る上で、Transformerの影響は欠かせません。

Transformerは自己注意機構(Self-Attention)により、入力のどの部分が重要かを動的に捉えます。

これにより、長い文脈の関係を扱いやすくなり、より自然で整合性のある生成につながるとされています。

ただし、Transformerの性能が高くても、学習データに偏りやノイズが多ければ、その影響を受けた出力になる可能性があります。

学習データの「量・品質・多様性」が精度に与える影響

量が増えると、一般にパターン学習の網羅性が上がります

学習データ量が増えると、モデルが観測できる言い回し、文脈、画像構図、音声パターンなどが増えます。

その結果、未知の入力に対しても近いパターンを参照しやすくなり、出力の安定性が上がると考えられます。

ただし、量を増やすだけでは不十分で、次に述べる品質と多様性が同時に重要になります。

品質が低いと、誤った規則を学びハルシネーションの要因になります

リサーチ結果では、低品質データが誤ったパターン学習を招き、ハルシネーション(幻覚)を引き起こす要因になり得ると整理されています。

たとえば、誤情報、矛盾した説明、出典不明の断定、重複だらけの文章などが混ざると、モデルは「それらしいが不正確」な文章を生成しやすくなる可能性があります。

このため、データ収集後のクレンジング(重複除去、ノイズ除去、品質評価)は、精度向上の鍵として注目されています。

多様性が不足すると、偏りやすくなります

学習データの多様性が不足すると、特定の視点や表現に過度に最適化され、偏った出力になり得ます。

これは、生成AIが確率分布を学習するという性質上、学習時に多く観測したパターンを“正しい”とみなしやすいことと関係します。

リサーチ結果でも、データの偏りが精度低下の要因となり、クリーンなデータ選別が重要だと示されています。

著作権や利用許諾はデータ戦略の前提条件になります

学習データを扱う際には、著作権や利用許諾の問題が重要な論点になります。

仮に高品質なデータであっても、権利関係が不明確であれば、学習や提供の継続が難しくなる可能性があります。

その結果として、利用できるデータが制約され、モデル改善の速度や方向性に影響が出ることも考えられます。

このため、企業利用では特に、データの出所、ライセンス、同意取得、社内規程との整合が重視されます。

今話題の生成AIとデジタルマーケに特化したeラーニングサービス【AI-MA】

eラーニングサービス「AI-MA」は、1授業10分前後でスマホからも閲覧できて、スキマ時間(合間:アイマ)で学べる「AIスキル」と「デジタルマーケティング」に特化した累計1,000本以上の講座で学べるeラーニングサービスです。今なら7日間無料トライアル実施中!

理解が進む具体例:学習データと精度の関係が見える場面

例1:社内FAQに特化した回答精度を上げたい場合

社内向けの生成AIを導入しても、「一般論は答えるが社内ルールに弱い」という課題が出ることがあります。

この場合、事前学習で得た一般知識だけでは不足し、社内規程、手順書、過去の問い合わせ履歴などを整備した上でファインチューニングやRAG(検索併用)を組み合わせる、という設計が検討されます。

ここでのポイントは、正解が明確な社内一次情報を学習・参照させるほど、誤回答やハルシネーションが減りやすい点です。

例2:画像生成で「それらしいが崩れた画像」が出る場合

Diffusion ModelやGANなどの画像生成モデルは実用化が進み、ビジネス活用も増加中とされています。

一方で、学習データにノイズが多い、解像度が不揃い、ラベルやキャプションが不正確、といった状態では、出力が破綻しやすくなる可能性があります。

リサーチ結果でも、画像生成の実用化が進む一方、データ品質の向上が精度向上の鍵として注目されている点が示されています。

品質管理としては、重複・低解像度・不適切コンテンツの除外、キャプション整備などが代表的です。

例3:対話AIが丁寧だが「言い切り」が多い場合

対話AIが一見丁寧でも、根拠が薄い内容を断定調で述べるケースがあります。

この背景には、事前学習データに含まれる断定的表現の影響や、RLHFの評価設計が「自信のある言い回し」を高く評価してしまう、といった可能性が考えられます。

対策としては、RLHFや追加学習の段階で、根拠提示や不確実性の表現を評価する方針にする、あるいは参照情報を明示させる運用ルールを設ける方法が検討されます。

例4:専門領域で用語の揺れが多い場合

医療、法務、製造などの専門領域では、用語の定義や言い回しが厳密に運用されます。

学習データ側で表記揺れが多いと、モデルが用語の境界を曖昧に学び、誤解を招く出力につながる可能性があります。

この場合、用語集の整備、正規化ルールの適用、信頼できる一次資料の比率を高めることが、精度改善に寄与すると考えられます。

生成AIの学習データを理解するための要点整理

生成AIの学習データとは、テキスト・画像・音声などの膨大なデータセットであり、生成AIが確率分布やパターンを学ぶための土台です。

自己教師あり学習により大規模データを効率的に学び、事前学習で汎用性を獲得したうえで、ファインチューニングやRLHFで用途に合わせた品質へ調整されます。

精度は学習データの量・品質・多様性の影響を強く受け、低品質データや偏りはハルシネーションや不適切な出力につながる可能性があります。

また、著作権や利用許諾の論点は、データ戦略そのものを左右し得るため、技術と同じくらい重要な前提条件になります。

次に取り組むとよい進め方

生成AIの精度を上げたい場合は、まず「モデル選定」よりも先に、学習・参照させたいデータの棚卸しから始めると進めやすいです。

具体的には、一次情報に近いデータを集めること、重複や誤情報を減らすこと、偏りが出ないように多様性を確保することが基本になります。

そのうえで、用途に応じてファインチューニングやRLHF、あるいは検索併用などの構成を検討すると、改善点が明確になりやすいと考えられます。

社内利用を想定している場合は、権利関係や取り扱いルールを早い段階で整理しておくと、運用段階での手戻りを減らせる可能性があります。