※当ページのリンクには広告が含まれています。

生成AIについて調べていると、「結局は何をしているのか」「なぜ文章や画像が自然に作れるのか」が分かりにくいと感じる方が多いと思われます。

専門用語としてTransformer、LLM、トークン化、拡散モデルなどが次々に出てきて、全体像がつかめないまま学習が止まってしまうこともあります。

本記事では、生成AIの中心的な仕組みを、初心者の方でも追えるように「入力→ベクトル化→確率予測→出力復元」の流れで図解し、テキスト・画像・音声で何が共通し、どこが違うのかを整理します。

従来のAI(判別AI)との違いや、2026年時点で注目されるマルチモーダル対応などの最新動向にも触れ、業務での理解や説明にも使える形でまとめます。

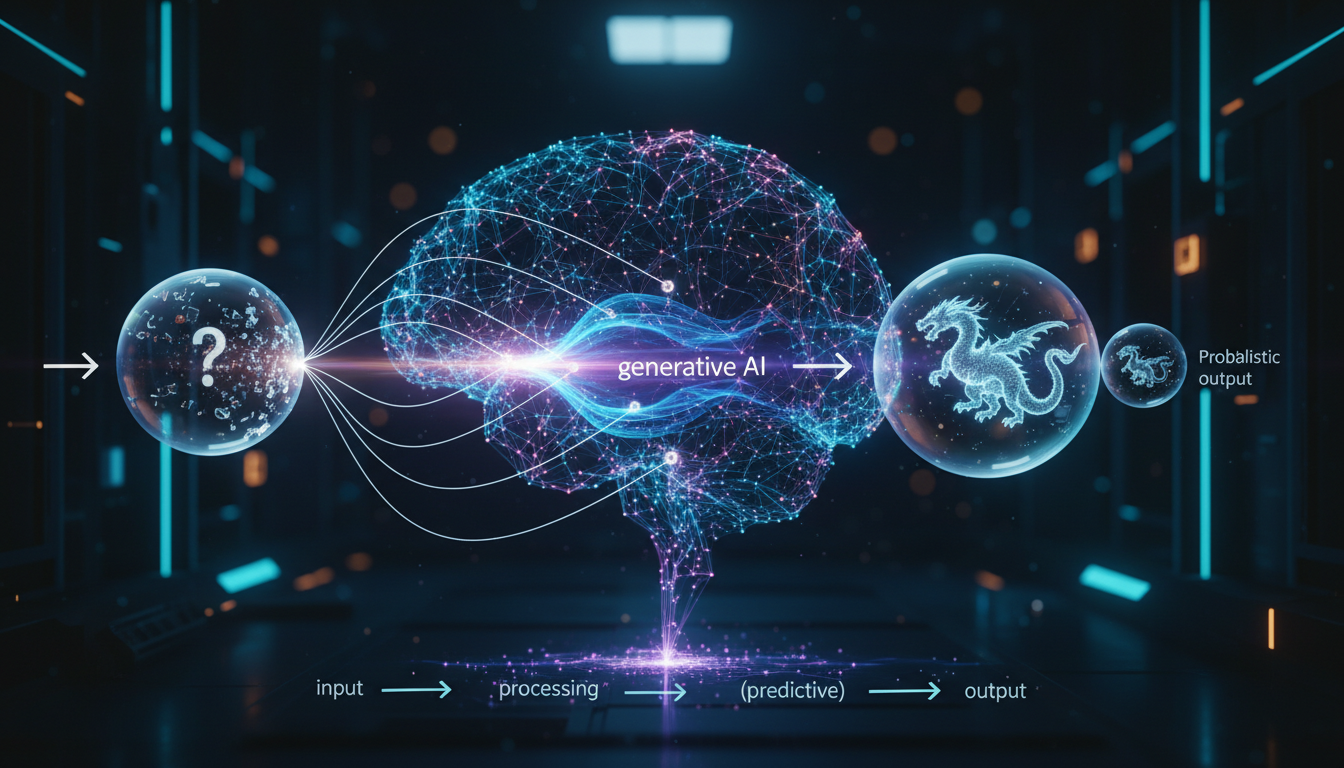

生成AIは「確率で次を予測して出力する」技術です

生成AIは、大量の学習データからパターンや分布を学習し、ユーザーの入力(プロンプト)に基づいて新しいテキスト、画像、音声などを自動生成するAI技術です。

中核は、入力を数値化(ベクトル表現)し、確率に基づいて次に来る要素を逐次予測・出力する推論プロセスだと整理できます。

テキスト生成ではTransformerを基盤とするLLMが「次のトークン」を予測し続け、画像生成では拡散モデルが「ノイズを少しずつ除去する」反復で画像を復元していく、と説明されます。

従来のAI(判別AI)が分類・予測に特化するのに対し、生成AIは「存在しないものを生み出す」点が大きな違いです。

図解でつかむ生成AIの全体像

まずは全体フローを1枚で理解します

初心者の方が混乱しやすいのは、個別の用語を先に覚えようとすることです。

先に全体像を押さえると、Transformerや拡散モデルの位置づけが理解しやすくなります。

図解:生成AIの基本フロー(共通骨格)

[1] 入力(プロンプト/画像/音声)

↓

[2] 数値化(トークン化・特徴抽出 → ベクトル表現)

↓

[3] モデル推論(確率的に次を予測 / 反復的に復元)

↓

[4] 出力復元(文章/画像/音声として人が読める形に戻す)

この「入力→ベクトル化→確率予測→出力復元」が、テキスト・画像・音声に共通する基本構造だとされています。

従来AI(判別AI)との違いが分かる整理

生成AIの理解では、「何が新しいのか」を比較で押さえるのが有効です。

判別AIは、入力に対して「正解ラベルは何か」「将来値はどれか」を当てる用途に強いとされます。

一方、生成AIはデータ分布を学び、もっともらしい新規データを作る方向に最適化されます。

| 観点 | 判別AI(従来) | 生成AI |

|---|---|---|

| 目的 | 分類・予測 | 新しい文章・画像・音声の生成 |

| 出力 | ラベルや数値 | コンテンツ(文章・画像など) |

| 考え方 | 境界を学ぶ(見分ける) | 分布を学ぶ(作り出す) |

生成AIの内部で起きていることを分解します

入力処理:トークン化とベクトル表現が出発点です

生成AIは、入力された文章をそのまま理解しているわけではありません。

一般に、文章は単語や語の単位に分解されるトークン化が行われ、各トークンは数値の並びであるベクトル表現に変換されます。

画像の場合はピクセルや特徴量を扱いやすい形にし、音声の場合は波形やスペクトログラムなどの特徴表現に変換する、と説明されます。

図解:テキスト入力の変換イメージ

「生成AIの仕組み」 ↓ トークン化 [生成][AI][の][仕組み] ↓ ベクトル化(数値の配列) v1, v2, v3, v4

この段階で重要なのは、AIが扱う世界が「数値空間」に移る点です。

モデル構造:Transformer(LLM)が文脈を保持します

テキスト生成の中心には、Transformerを基盤とする大規模言語モデル(LLM)があるとされています。

Transformerは文脈を保持しながら、次に来るトークンの確率を推定する自己回帰型の仕組みが核心です。

これにより、直前の単語だけでなく、文章全体の流れに整合する候補を選びやすくなります。

「次の1語(1トークン)を当てる」ことを繰り返す結果として、段落や文章が生成されます。

確率的推論:正解を1つ決め打ちせず、候補から選びます

生成AIの出力が毎回少し変わるのは、確率で候補を選ぶ工程があるためです。

モデルは「次に来るトークンの候補」を複数提示し、それぞれに確率を割り当てます。

その上で、確率分布からサンプリングして次トークンを決め、文章を伸ばしていくと整理できます。

確率的推論は、自然さと多様性を両立させる要素だと考えられます。

学習方法:大量データで分布を学ぶのが基本です

生成AIはディープラーニングにより、大量データを用いて訓練されます。

一般に、テキストでは「次トークン予測」が学習目標となり、画像では拡散モデルのように「ノイズから元画像を復元する能力」を学習する枠組みが用いられます。

また、画像生成の文脈ではGANも代表的で、生成側と識別側が競争しながら精度を高める方式として知られています。

出力生成:3ステップで整理すると理解しやすいです

実運用の観点では、生成AIの出力は次の3ステップで説明されることが多いです。

- プロンプト入力

- モデル推論

- 自然言語・画像などの出力

内部の詳細は複雑でも、この3ステップに落とすと、利用者さん向けの説明が簡潔になります。

モデル別に見る生成AIの仕組み

テキスト生成(LLM):次トークン予測の積み重ねです

ChatGPTのような対話型生成AIは、LLMによるテキスト生成の代表例です。

プロンプトをトークン化し、文脈を踏まえて次トークンを確率的に選び続けることで文章を構成します。

図解:テキスト生成の逐次生成

入力: 「生成AIとは」 ↓ 次トークン候補: 「何」「、」「大量」...(確率付き) ↓ サンプリング 出力: 「生成AIとは、」 ↓(同様に繰り返し) 文章が伸びる

画像生成(拡散モデル):ノイズ除去を反復して画像を復元します

画像生成では、拡散モデルが広く注目されています。

考え方は、ランダムなノイズ状態から出発し、少しずつノイズを取り除く反復で画像を作る、というものです。

近年はノイズ除去の精度向上や改良が進み、高精度生成が注目されています。

画像生成(GAN):生成と識別の競争で品質を上げます

GANは、生成モデル(偽物を作る)と識別モデル(本物か見分ける)が競争しながら学習します。

識別側をだます方向に生成側が改善されるため、リアルな画像が得られやすい一方、学習の安定化が課題になりやすいとも言われています。

音声生成:TransformerとVocoderの組み合わせが代表的です

音声生成では、テキストから音声特徴を作り、Vocoderなどで波形に変換する構成が用いられることがあります。

Transformer系のモデルが文脈を扱い、最終的に人が聞ける音として復元される流れだと整理できます。

今話題の生成AIとデジタルマーケに特化したeラーニングサービス【AI-MA】

eラーニングサービス「AI-MA」は、1授業10分前後でスマホからも閲覧できて、スキマ時間(合間:アイマ)で学べる「AIスキル」と「デジタルマーケティング」に特化した累計1,000本以上の講座で学べるeラーニングサービスです。今なら7日間無料トライアル実施中!

具体的なイメージがつかめる活用例

例1:メール文面の作成(テキスト生成)

たとえば「取引先への日程変更のお願い」をプロンプトとして入力するとします。

生成AIは、入力文をトークン化してベクトル化し、文脈に合う次トークンを確率的に選びながら、丁寧語や必要情報の順序を整えた文面を生成します。

このとき、同じ条件でも表現が微妙に変わるのは、確率分布からのサンプリングが関与するためだと説明されます。

例2:雨の日の旅行アイデア出し(ビジネスの発想支援)

2026年時点では、企業向けの導入手引きや活用事例の紹介が活発で、アイデア生成用途が強調される傾向があります。

「雨の日でも楽しめる旅行プラン」を入力すると、生成AIは学習データ中の旅行・天候・屋内施設などのパターンを参照し、もっともらしい候補を文章として組み立てます。

人がゼロから考える負担を減らし、たたき台を作る用途に向くと考えられます。

例3:商品画像のラフ生成(拡散モデル)

「白背景、ミニマルなデザイン、青系のアクセント」といった条件を与えると、拡散モデルはノイズから反復的に画像を復元し、条件に近いラフ案を生成します。

この工程は「一度で完成品を出す」というより、候補を複数出し、デザイン検討の速度を上げる使い方が現実的だと思われます。

例4:会議音声の要約(マルチモーダルへの発展)

近年のトレンドとして、テキスト・画像・音声を統合するマルチモーダル対応が注目されています。

音声を文字に起こし、文脈理解と要約生成を組み合わせることで、議事録のドラフトを作る運用が考えられます。

重要なのは、入力形式が変わっても「数値化→推論→復元」の骨格は共通という点です。

生成AIを理解するための要点整理

生成AIは、大量データからパターンや分布を学び、プロンプトに応じて新しいコンテンツを生成する技術です。

仕組みは、入力をベクトル表現に変換し、確率に基づいて次を予測して出力する流れとして整理できます。

- テキストはLLM(Transformer)で次トークンを逐次生成します。

- 画像は拡散モデルのノイズ除去反復、またはGANの競争学習などが代表例です。

- 従来AIが分類・予測中心なのに対し、生成AIは新規データを作る点が異なります。

- マルチモーダルは2026年時点の重要トレンドの1つとされています。

次に何から学ぶと理解が進みやすいです

生成AIは範囲が広いため、最初から細部まで追うと負担が大きくなりやすいです。

まずは本記事の図解のように、「入力→ベクトル化→確率予測→出力復元」の流れを自分の言葉で説明できる状態を目指すとよいと思われます。

その上で、文章生成に関心がある方はトークン化とTransformerの概要から、画像生成に関心がある方は拡散モデルの反復的ノイズ除去の考え方から学ぶと、理解が積み上がりやすいと考えられます。

業務で使う場合は、用途ごとに「入力形式」「出力形式」「確認すべきリスク(誤情報や権利関係など)」を整理し、小さなタスクから試すと導入判断がしやすくなります。