※当ページのリンクには広告が含まれています。

業務効率化やクリエイティブな作業において、生成AIの活用はもはや無視できない潮流となっています。

しかし、その利便性を享受する一方で、「ニュースで聞くようなトラブルに巻き込まれないか」「社内の情報が漏洩してしまわないか」といった不安を感じている方も多いのではないでしょうか。

技術の進化は早く、リスクの実態も日々変化しています。

特にこれからの数年は、AIの普及と共にセキュリティリスクが重大化する局面を迎えるといわれています。

この記事では、生成AIに潜む主要な問題点とリスクを体系的に整理し、明日から実践できる対策とともに解説します。

正しい知識を身につけることで、漠然とした不安を解消し、安全にAIを活用するための第一歩を踏み出しましょう。

生成AIのリスク管理は組織の存続に関わる重要課題です

結論から申し上げますと、生成AIの問題点とリスクを理解することは、単なるツールの使い方の話ではなく、企業のコンプライアンスや社会的信用を守るための経営課題そのものです。

生成AIは「魔法の杖」ではなく、確率に基づいて答えを出力するプログラムであり、その構造上、誤情報や権利侵害のリスクを完全には排除できないからです。

特に近年では、組織のリーダーたちの懸念が「外部からの攻撃」だけでなく、「内部からの意図しないデータ漏洩」へとシフトしていることが指摘されています。

利便性の裏側にあるリスクを正しく評価し、適切なルールを設けることが、AI活用の大前提となります。

なぜ生成AIには多くの問題点が存在するのでしょうか?

生成AIが画期的な技術であるにもかかわらず、なぜこれほど多くのリスクが懸念されているのでしょうか。

その理由は、AIの「仕組み」と「学習データ」の性質に深く関係しています。

ここでは、根本的な原因を3つの視点から掘り下げて解説します。

1. 確率論的な生成による「もっともらしい嘘」

生成AI、特に大規模言語モデル(LLM)は、事実を理解して回答しているわけではありません。

膨大なテキストデータの中から、「次にくる単語として何が最も確率が高いか」を計算し、文章をつなぎ合わせているに過ぎないのです。

そのため、AIは事実とは異なる内容であっても、非常に流暢で自然な文体で出力してしまいます。

これを「ハルシネーション(幻覚)」と呼びます。

「自信満々に嘘をつく」という特性が、誤情報の拡散や意思決定のミスを誘発する最大の要因となっています。

2. 学習データの透明性と公平性の欠如

AIが学習するデータは、インターネット上のあらゆる情報を含んでいます。

その中には、著作権で保護されたコンテンツや、個人のプライバシー情報、あるいは偏見を含んだ意見も混在しています。

AIはそれらを区別なく学習してしまうため、出力結果に特定のバイアス(差別や偏見)が反映されたり、既存の著作物に酷似したコンテンツが生成されたりする可能性があります。

学習データの「ブラックボックス化」が、権利侵害や倫理的な問題を引き起こす温床となっているのです。

3. 技術の進化に法整備やリテラシーが追いついていない

生成AIの進化スピードは凄まじく、法的な規制や社会的なガイドラインの整備が追いついていないのが現状です。

例えば、AIが生成した画像の著作権の所在や、AIによる名誉毀損の責任の所在など、法的にグレーな領域が多く残されています。

また、利用者のリテラシー不足もリスクを高める要因です。

「AIに入力した情報は学習に使われる可能性がある」という認識がないまま機密情報を入力してしまうケースが後を絶ちません。

技術と社会ルールのギャップが、トラブルを複雑化させています。

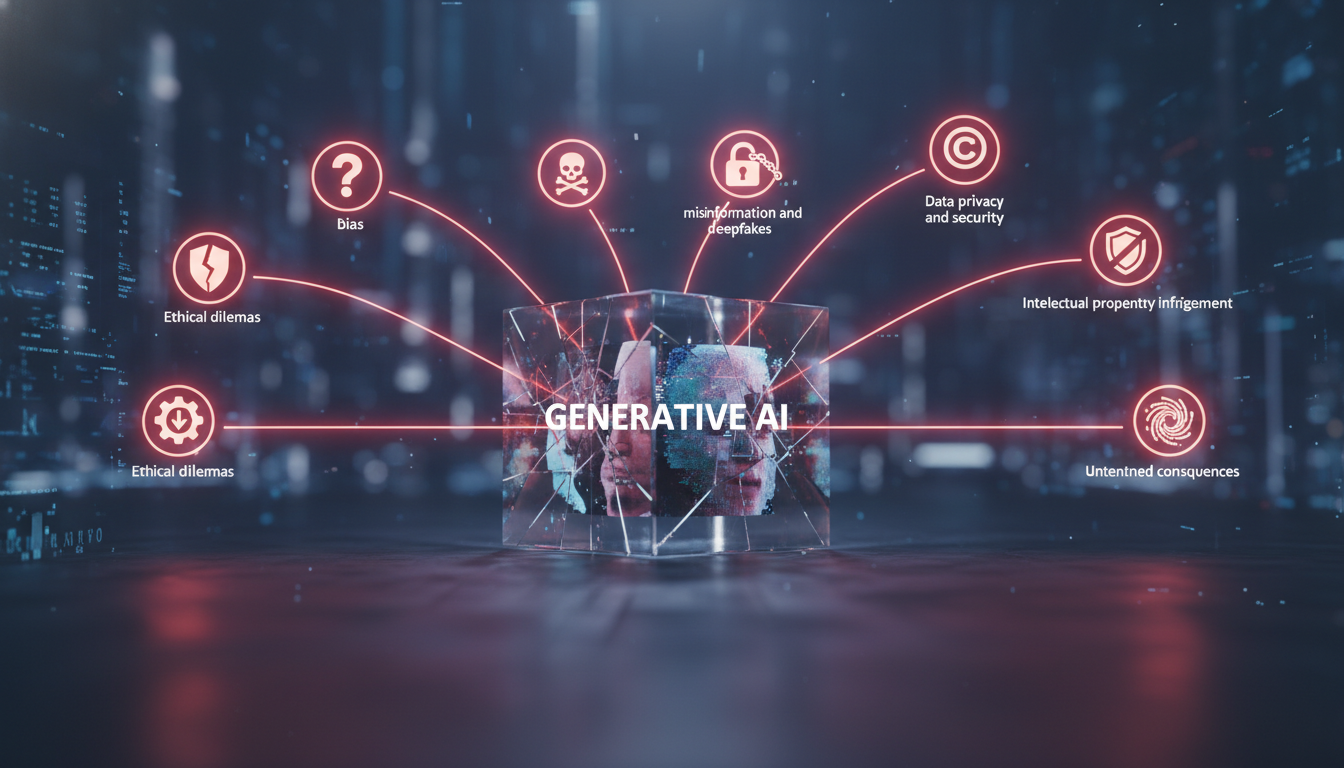

知っておくべき7つのリスクと具体的な事例

それでは、具体的にどのようなリスクが存在するのでしょうか。

ここでは、ビジネス現場や社会生活において特に注意すべき7つの問題点を、最新の動向を交えて詳しく解説します。

① ハルシネーション(誤情報の生成と拡散)

前述の通り、AIが事実に基づかない情報を生成する現象です。

もっともらしい文章で作成されるため、人間の目視でも見抜くのが難しい場合があります。

具体的なリスク:

例えば、企業の広報担当者さんがAIを使ってプレスリリースを作成した際、存在しない製品スペックや過去の実績が勝手に盛り込まれてしまう可能性があります。

これをそのまま公開すれば、虚偽表示として企業の信頼は失墜します。

また、医療や法律といった専門分野で誤った助言が生成されれば、深刻な実害に発展しかねません。

対策:

AIの出力は必ず「下書き」として扱い、最終的には人間がファクトチェックを行う仕組み(Human-in-the-loop)を徹底することが不可欠です。

② 情報漏洩(機密情報の流出)

多くの生成AIサービスでは、デフォルトの設定で「ユーザーの入力データをAIの学習に利用する」規約になっていることがあります。

これにより、社外秘の情報をAIに入力した結果、その情報が他社のユーザーへの回答として出力されてしまうリスクがあります。

具体的なリスク:

エンジニアさんがプログラムの修正をAIに依頼する際、社外秘のソースコードをそのまま貼り付けてしまうケースや、議事録の要約のために未発表の新製品情報を入力してしまうケースなどが該当します。

組織のリーダーたちの懸念が「攻撃的な利用」から「意図しないデータ漏洩」へ移行しているという調査結果もあり、内部統制の重要性が増しています。

対策:

企業向けの「学習に利用されないプラン」を契約する、または個人情報や機密情報をマスキングして入力するといったガイドラインの策定が必要です。

③ 著作権・知的財産権の侵害

生成AIは既存の著作物を大量に学習しているため、特定の作家やアーティストの画風、あるいは文章スタイルに酷似したコンテンツを生成することが可能です。

これが「依拠性」や「類似性」を満たす場合、著作権侵害として訴訟に発展するリスクがあります。

具体的なリスク:

マーケティング担当者さんが広告用の画像をAIで生成したところ、有名なキャラクターや既存のイラストに酷似しており、権利者から訴えられるというケースが想定されます。

実際に海外では、作家やアーティストによる集団訴訟も起きています。

対策:

商用利用可能なクリーンなデータで学習されたAIモデルを選定する、生成物が既存の著作物に似ていないか画像検索等で確認するといったプロセスが求められます。

④ バイアス(差別・偏見)の助長

学習データに偏りがある場合、AIの出力にもそれが反映されます。

特定の性別、人種、職業に対するステレオタイプな表現が出力されることがあります。

具体的なリスク:

採用活動でAIを活用した際、特定の性別や出身大学に対して不当に低い評価を下す可能性があります。

また、「医師」の画像を生成させると男性ばかりが表示される、「看護師」だと女性ばかりが表示されるといったジェンダーバイアスも報告されています。

対策:

AIの判断を鵜呑みにせず、公平性の観点から人間が最終判断を下すことが重要です。

⑤ 悪用リスク(詐欺・サイバー攻撃)

生成AIの能力は、悪意ある攻撃者にとっても強力な武器となります。

高度なフィッシングメールの作成や、マルウェアのコード生成などが容易に行えるようになっています。

具体的なリスク:

本物と見分けがつかないような自然な日本語での詐欺メールが大量に送信されるリスクがあります。

また、著名人の声や顔を模倣した「ディープフェイク」を用いた詐欺や、選挙期間中の世論操作(偽情報の拡散)も深刻な社会問題となっています。

「2026年はAIのセキュリティリスクが重大化する」との予測もあり、警戒が必要です。

⑥ 人間の思考力・創造力の低下

AIに頼りすぎることで、人間自身のスキルが低下する懸念もあります。

「AIが答えを出してくれる」という状況に慣れると、批判的思考(クリティカルシンキング)や、ゼロからアイデアを生み出す力が弱まる可能性があります。

対策:

AIはあくまで「思考の補助ツール」として位置づけ、最終的な意思決定や創造的な仕上げは人間が行うという意識を持つことが大切です。

⑦ 「2026年問題」とデータ枯渇

最新の動向として注目されているのが、AIの学習データが不足する「データ枯渇問題」です。

高品質な人間のテキストデータは2026年頃までに枯渇すると予測されており、AIの性能向上が頭打ちになる、あるいはAIが生成したデータをAIが学習することで品質が劣化する(モデル崩壊)リスクが指摘されています。

これにより、将来的にAIツールの開発難易度が上がり、コストが増加したり、精度の低いAIが出回ったりする可能性があります。

今話題の生成AIとデジタルマーケに特化したeラーニングサービス【AI-MA】

eラーニングサービス「AI-MA」は、1授業10分前後でスマホからも閲覧できて、スキマ時間(合間:アイマ)で学べる「AIスキル」と「デジタルマーケティング」に特化した累計1,000本以上の講座で学べるeラーニングサービスです。今なら7日間無料トライアル実施中!

リスクを正しく恐れ、賢く活用するために

ここまで、生成AIの多岐にわたる問題点を見てきました。

不安に感じられたかもしれませんが、重要なのは「AIを使わないこと」ではなく、「リスクをコントロールしながら使うこと」です。

IPA(情報処理推進機構)などの公的機関が発表するガイドラインや、セキュリティ企業による最新のレポート(例えば「情報セキュリティ10大脅威」など)を定期的に確認し、組織全体でリテラシーを高めていくことが最大の防御策となります。

効果的な対策のまとめ:

- ルールの策定:入力してはいけない情報、出力結果の確認義務などを明文化する。

- 教育・研修:従業員に対して、著作権やセキュリティに関する定期的な研修を行う。

- ツールの選定:セキュリティ対策が万全な法人向けプランや、学習データがクリアなAIモデルを選択する。

- 人間による監視:AI任せにせず、必ず人間が介在するプロセス(Human-in-the-loop)を構築する。

変化を恐れず、新しい技術と向き合うあなたへ

生成AIの問題点とリスクを深く知ろうとする姿勢は、これからの時代において非常に価値のあるスキルです。

リスクを知っているからこそ、無防備に飛びつくのではなく、安全な道筋を選んで技術の恩恵を最大限に引き出すことができるはずです。

2026年に向けてAIはさらに社会に浸透していきます。

「怖いから使わない」と遠ざけるのではなく、「弱点を知っているから使いこなせる」という自信を持って、AIとの共存を模索していってください。

あなたのその慎重さと誠実さが、組織やプロジェクトを守る大きな力になることでしょう。